언어 모델

대규모 언어 모델로 ‘다음 최선의 행동’을 위한 추천 시스템 구동하기

추천 시스템은 Netflix와 Amazon 같은 디지털 플랫폼에서 사용자 경험을 개인화하는 데 큰 역할을 합니다. 이러한 시스템은 복잡한 머신러닝 알고리즘을 사용하여 사용자의 행동, 선호도, 상호 작용을 분석하고 개인화된 추천을 생성합니다. 추천 시스템은 크게 협업 필터링, 콘텐츠 기반 필터링, 하이브리드 방법으로 나눌 수 있습니다.

PostgreSQL과 함께 Supabase의 벡터 데이터베이스 사용하기

이 가이드에서는 Supabase와 OpenAI를 이용해 벡터와 임베딩을 관리하고 처리하는 방법을 살펴보았습니다. 벡터와 임베딩은 유사성 검색, 군집화, 추천 시스템 등 다양한 응용 분야에서 중요한 역할을 하며, PostgreSQL 확장인 pgvector를 통해 데이터베이스에서도 이를 쉽게 다룰 수 있습니다. 이 도구들을 활용하면 지능적이고 문맥에 맞는 애플리케이션을 개발할 수 있습니다.

MIT 연구자들, 소프트웨어 개발에서 대규모 언어 모델 통합을 간소화하기 위한 도메인 특화 언어 AskIt 제안

AskIt은 대규모 언어 모델(Large Language Models, LLMs)을 소프트웨어 개발에 통합하기 위한 도메인 특화 언어입니다. 이는 타입 가이드된 출력, 템플릿 기반 함수 정의, 예시를 통한 프로그래밍 등 다양한 기능을 제공하여 LLMs의 사용을 간소화합니다. 이러한 기능들은 자연어 처리, 문제 해결, 코드 생성 등 다양한 작업에 LLMs를 더 효과적으로 활용할 수 있도록 도와줍니다.

Prompting, RAG 또는 Fine-tuning을 사용해야 할까요?

언어 모델 응용 프로그램(LLM)을 구축할 때 선택할 수 있는 여러 접근 방식에는 프롬프트 엔지니어링, 검색 증강 생성(RAG), 그리고 파인 튜닝이 있습니다. 각 접근 방식은 특정 작업의 성격, 훈련 데이터의 유무, 그리고 품질, 비용, 지연 시간 등에 따라 장단점이 있습니다. 일련의 질문을 통해 사용 사례에 가장 적합한 방법을 결정할 수 있으며, 이러한 방법들은 상호 보완적으로도 작동할 수 있습니다.

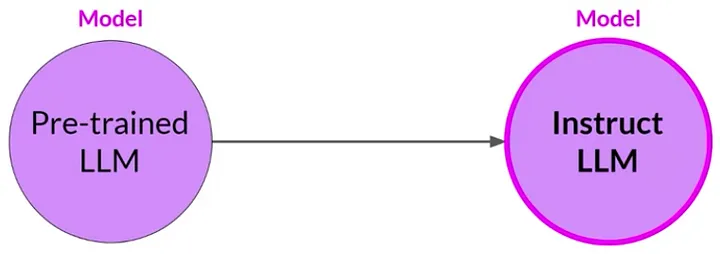

Fine-tuning LLMs

Fine-tuning LLMs Tasks to finetune Before Fine-tuning (base or pretrained model) Fine-turning 지도 학습 과정은 지시 프롬프트(instruction prompts)를 사용하여 언어 모델(LLM)을 미세 조정하는 것을 포함합니다. 지도 학습(supervised learning)은 머신 러닝의 한 분야로, 모델이 레이블이 지정된 데이터 세트에서 학습하는 방법입니다. 이러한 과정에서 모델은 입력 데이터와 해당 레이블 사이의 관계를 학습하려고 시도합니다. “언어 모델(LLM)”은 텍스트 데이터를 처리하고…

Spring AI는 OpenAI와 Azure OpenAI와의 통합을 제공합니다

Spring AI Provides Integration with OpenAI and Azure OpenAI Spring AI 프로젝트는 SpringOne 컨퍼런스 동안 소개되었으며, Spring의 일반적인 개념을 사용하여 AI 애플리케이션을 생성할 수 있게 해줍니다. 현재 이 프로젝트는 Azure OpenAI와 OpenAI를 AI 백엔드로 통합하고 있습니다. 콘텐츠 생성, 코드 생성, 의미론적 검색, 요약과 같은 사용 사례가 프로젝트에 의해 지원됩니다. 역사적으로, Python은 C와 C++와 같은 언어로 작성된…

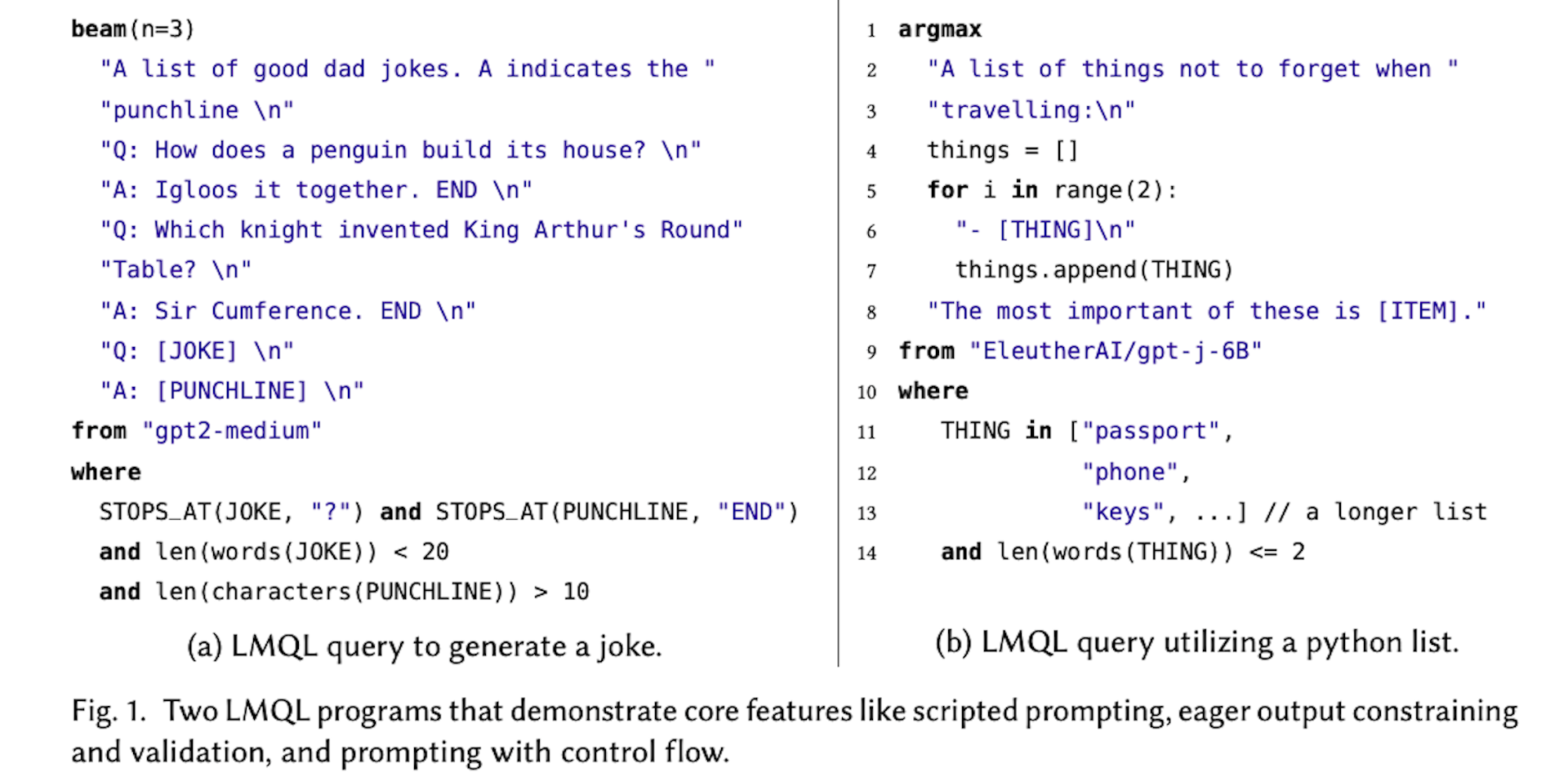

LMQL, Python의 상위 집합인 방법으로 개발자가 LLM을 사용하는 데 어떻게 도움을 주는가

How LMQL, a Superset of Python, Helps Developers Use LLMs 이 블로그는 대규모 언어 모델(Large Language Models, LLMs)과의 상호작용에 있어 자연어의 한계에 대해 논의하고 있습니다. ETH Zürich의 박사과정 학생인 루카 부어러-켈너(Luca Beurer-Kellner)에 따르면, 자연어는 본질적으로 비공식적이고 덜 정확하다는 단점이 있습니다. 이 문제를 해결하기 위해 부어러-켈너와 그의 동료들은 Language Model Query Language (LMQL)이라는 새로운 프로그래밍 언어를…

어떻게 GPT4 데이터 없이 코드 LLMs를 명령어 튜닝할까요?

How to Instruction Tune Code LLMs without GPT4 Data? Meet OctoPack: A Set of AI Models for Instruction Tuning Code Large Language Models [논문] OCTOPACK: INSTRUCTION TUNING CODE LARGE LANGUAGE MODELS 큰 언어 모델(LLM)의 사용성 및 전체 성능은 지시어를 통해 제공된 다양한 언어 작업을 미세 조정함으로써 향상될 수 있다는 것이 증명되었습니다 (instruction tuning). 시각, 청각,…

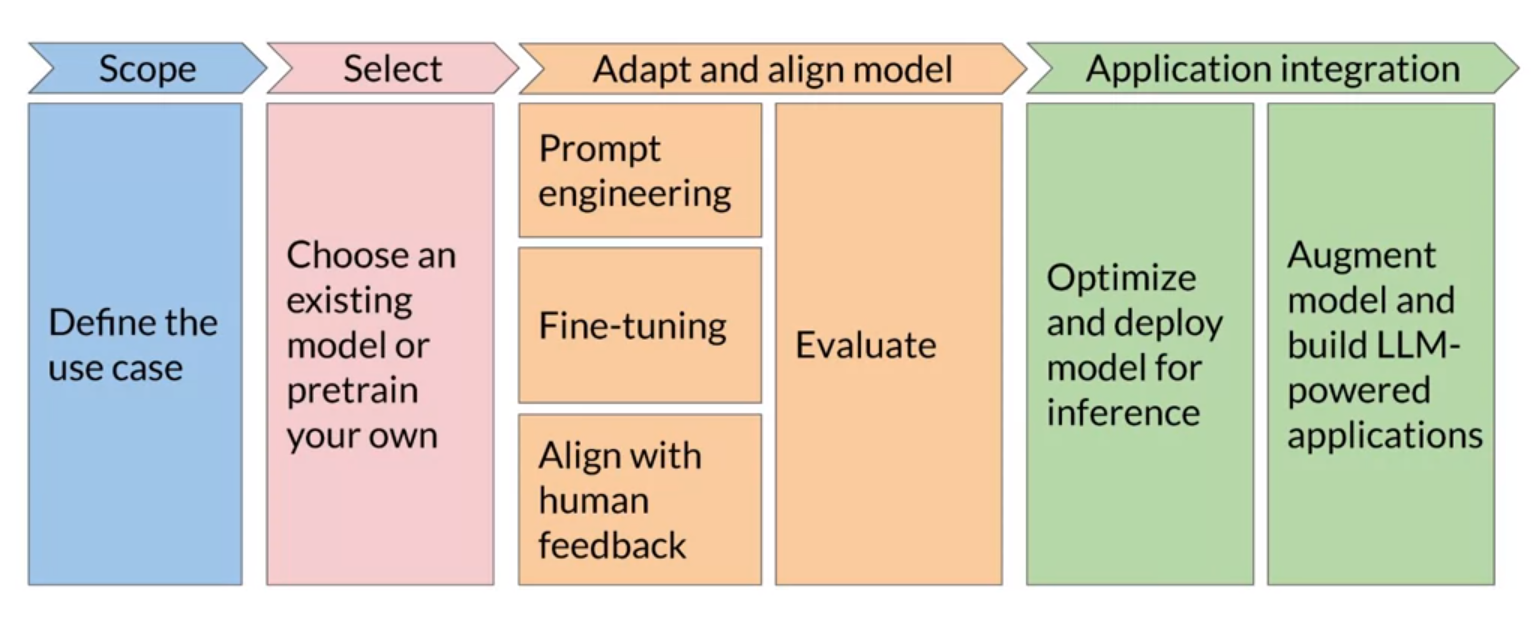

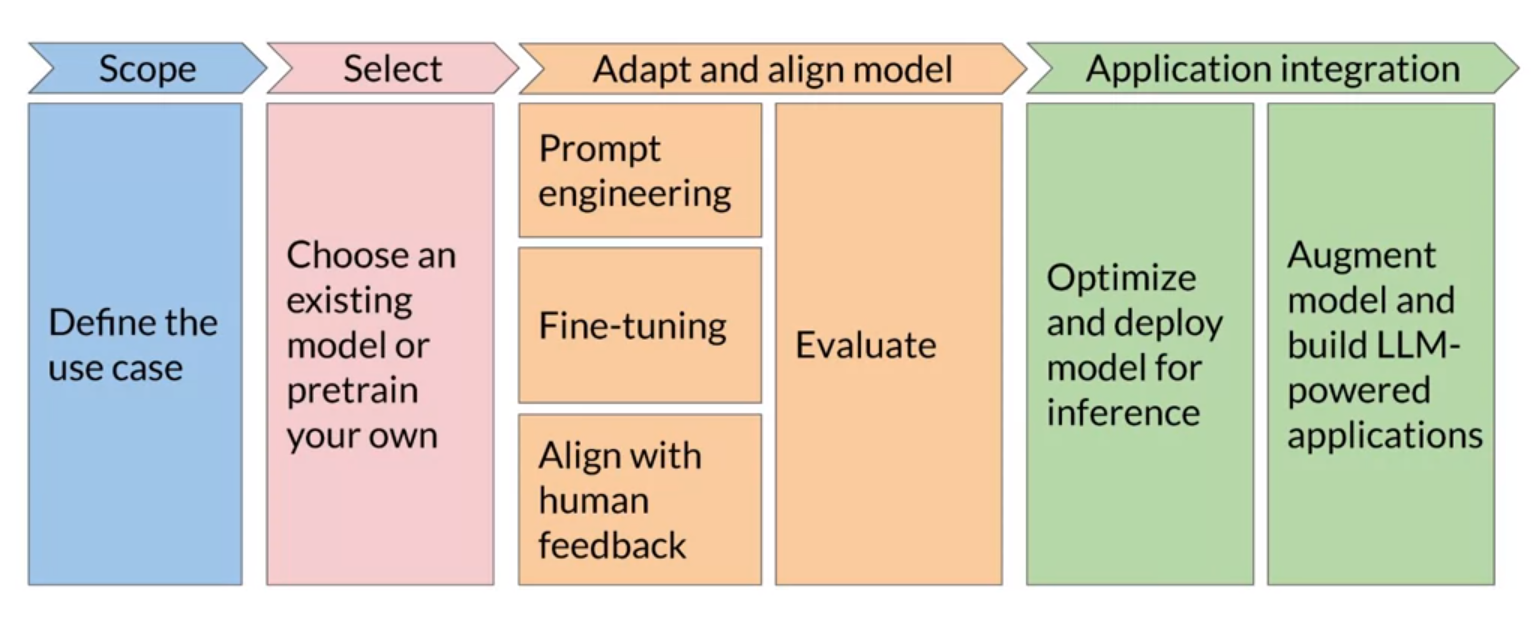

Generative AI project lifecycle

Generative AI 프로젝트의 수명 주기는 사용 사례를 정의하는 범위 설정, 기존 모델 선택 또는 자체 모델의 사전 훈련, 모델의 적응 및 조정, 그리고 응용 프로그램 통합으로 구성됩니다. 이 과정에서는 모델의 프롬프트 엔지니어링, 미세 조정, 인간의 피드백과 조정 및 성능 평가를 포함합니다. 마지막으로, 모델을 실제 환경에 배포하고, LLM 기술을 활용한 응용 프로그램을 개발합니다.

Generative AI의 새로운 패러다임

기술적 발전에 따라 인공 지능, 특히 대규모 언어 모델과 생성적 AI는 비즈니스 문제 해결에서 중요한 역할을 하고 있습니다. OpenAI와 같은 기업들은 AI의 상용화와 이용을 단순화하고 확장시켰습니다. 그러나 이러한 AI 기술은 도덕적, 법적 문제와 데이터 보안 문제를 일으킬 수 있습니다. 이러한 위험에도 불구하고, 기업들은 AI의 잠재력을 탐구하며, 적절한 관리와 실행을 통해 그 장점을 활용하고 있습니다.